Un projet collaboratif, des millions d’images et de l’intelligence artificielle

pour développer un outil de reconnaissance automatique des espèces animales en Europe

Cette dernière décennie, les pièges photographiques sont devenus essentiels au recensement de la faune et au suivi et à la gestion de nombreuses espèces. Les images collectées, souvent des centaines de milliers, doivent cependant être inspectées et classées une à une par espèces, une tâche longue et fastidieuse.

Les progrès des outils de l’intelligence artificielle, et en particulier des modèles dits d’apprentissage profond (deep learning en anglais), doivent permettre d’automatiser cette étape de tri et de classification des images. Avant l’initiative DeepFaune, il n’y avait cependant pas de modèle applicable à la faune française hexagonale, et développer un tel modèle a été l’objectif principal de l’initiative.

Le succès de la phase d’apprentissage des modèles de classification reposant sur le fait d’avoir accès à des milliers d’images annotées - c’est à dire des images pour lesquelles l’espèce présente a été identifiée par une personne - une approche collaborative avec de nombreux partenaires a été mise en place pour construire, en agrégeant les images des partenaires, la plus large base d’images annotées possible. Cette collaboration a permis le développement d’un modèle performant.

Pour que ce modèle soit utilisables par tous, partenaires de l’initiative ou non, un logiciel gratuit et simple d’accès a été développé, permettant aux utilisateurs de classer leurs images de pièges photographiques.

Données

et Modèle

Une très large base d’entrainement

Le succès de la collaboration avec de nombreux partenaires a permis d’obtenir plus d’un million d’images et de vidéos annotées, probablement la plus large base de données de ce genre en France.

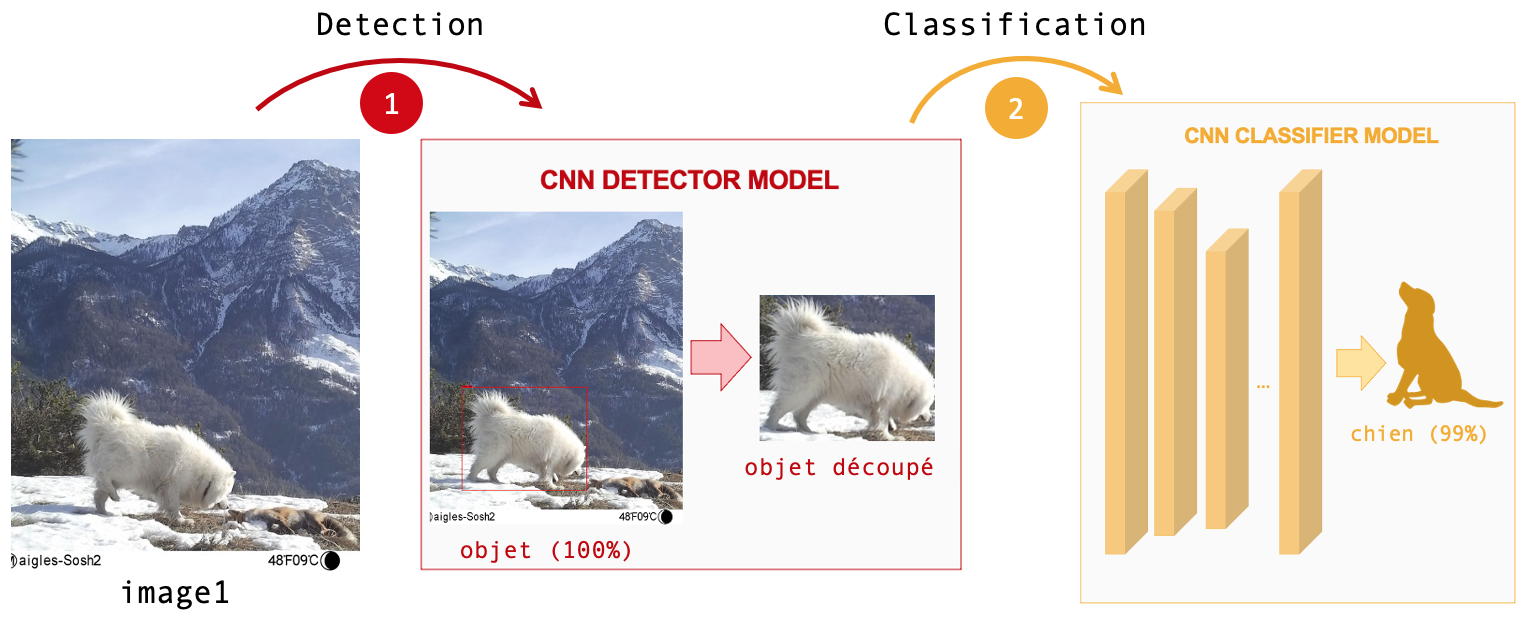

Un double traitement des images

Notre approche est constituée de deux étapes: une première étape de détection de l’animal dans l’image, puis une étape de classification dans laquelle le modèle identifie l’espèce ou le taxon auquel l’animal appartient.

Espèces reconnues et performance du modèle

A l’heure actuelle, le modèle utilise 37 classes. Chaque image ou vidéo qui lui est soumise, prise de jour comme de nuit, est prédite comme contenant:

- rien: classe ‘vide’

- une présence humaine: classes ‘humain’, ‘véhicule’

- un ongulé sauvage: classes ‘bison, ‘bouquetin’, ‘cerf’, ‘chevreuil’, ‘chamois/isard’, ‘daim’, ‘éland’, ‘mouflon’, ‘renne’, ‘sanglier’

- un autre grand mammifère: classes ‘glouton’, ’loup’, ’lynx’, ‘ours’

- un petit mammifère: classes ‘blaireau’, ‘castor’, ‘écureuil’, ‘genette’, ‘hérisson’, ’lagomorphe’, ’loutre’, ‘marmotte’, ‘mustélidé’, ‘ragondin’, ‘raton laveur’, ‘renard’

- un animal domestique: classes ‘chien’, ‘chat’, ‘chèvre’, ‘équidé’, ‘mouton’, ‘vache’

- un animal autre, de la classe ‘oiseau’ ou de la classe ‘micromammifère’

Les images pour lesquelles le score de confiance de la prédiction est sous un seuil défini par l’utilisateur sont attribuées à une classe ‘indéfini’ et devront être inspectées visuellement.

Cependant, pour beaucoup d’espèces les prédictions sont justes plus de 95 % des fois ! (résultats par espèce ici).

N’hésitez pas à tester le logiciel sur vos propres images, et à nous faire retour !

Les performances du modèle évoluent régulièrement, au gré des améliorations que nous y apportons et de l’ajout d’images à la base de données. Si vous avez identifié des espèces sur des images ou vidéos de pièges photographiques, vous pouvez nous aider à améliorer le modèle. Ecrivez nous pour contribuer !

Vous souhaitez en savoir plus ?

Et vous pourriez également être intéressé par

Logiciel

Nous mettons à disposition un logiciel gratuit, simple d’usage permettant de classifier, à l’aide du modèle DeepFaune, des images ou des vidéos de pièges photographiques. Ce logiciel permet également de copier ou déplacer ces images ou vidéos dans des dossiers distincts, selon les résultats de la classification.

Ce logiciel est fait pour être utilisable sur un ordinateur de bureau standard, sans avoir besoin d’envoyer les images ou vidéos sur un serveur distant.

– Téléchargement et usage –

- Windows:

- Téléchargez le dossier compressé ici, et décompressez le à l’emplacement de votre choix. Ce dossier peut être effacé après l’installation réalisée en étape 2.

- Installez en double-cliquant sur le fichier

deepfaune_installer.exe - Lancez le logiciel DeepFaune comme n’importe quel autre logiciel Windows.

- Linux/Mac:

- Téléchargez le dossier compressé ici.

- Décompressez le dossier à un emplacement aisément accessible, car vous devrez y accéder à chaque démarrage du logiciel.

- Suivez les instructions détaillées dans le fichier

README.md

Le code source est ici: https://plmlab.math.cnrs.fr/deepfaune/software/

Pour toute aide ou suggestion, contactez nous

Partenariat

Les partenaires du projet, plus d’une soixantaine à ce jour, participent à celui-ci en contribuant des images mais également à la réflexion autour des objectifs du projet DeepFaune, et des besoins des utilisateurs finaux.

Ces partenaires sont des parcs naturels régionaux ou nationaux, des fédérations de chasseurs, des associations naturalistes, des laboratoires de recherche et même de simples individus, tous impliqués dans la conservation et la gestion de la biodiversité aux échelles locales, régionales ou nationales. Nous avons également de nombreux partenaires européens.

Vous souhaitez rejoindre le projet DeepFaune ? Contactez nous !

L’équipe

L'équipe DeepFaune est également composée de Gaspard Dussert (Laboratoire de Biométrie et Biologie Evolutive (LBBE), Lyon), Claire Rossignol (CEFE) et Bruno Spataro (LBBE).

Simon Chamaillé-Jammes est directeur de recherche CNRS, spécialisé en dynamique des populations et écologie comportementale.

Vincent Miele est ingénieur de recherche CNRS, spécialiste des techniques de vision par ordinateur par deep learning en écologie.

Gaspard Dussert est doctorant en apprentissage machine et développe plus avant les algorithmes des modèles DeepFaune.

Claire Rossignol est ingénieure en machine learning et nous aide sur la gestion de données et les entrainements, recrutée grâce au projet BIODIVERSA BigPicture.

Bruno Spataro est ingénieur de recherche CNRS et gère le centre de calcul et les serveurs de stockage du centre PRABI-LBBE.